(通訊員程齊凱)近日,第29屆ACM計算機與通信安全會議(ACM Conference on Computer and Communications Security, CCS 2022)官方發(fā)布了論文錄用結(jié)果。我院2020級博士研究生劉家偉以第一作者身份撰寫的論文被錄用。

該論文題目為“Order-Disorder: Imitation Adversarial Attacks for Black-box Neural Ranking Models”(《有序-無序:針對黑盒神經(jīng)排序模型的模仿對抗攻擊》),武漢大學為第一單位,指導教師為我院陸偉教授(通訊作者)、美國伍斯特理工學院劉曉鐘副教授(共同通訊作者)、美國印第安納大學Xiaofeng Wang教授,阿里巴巴達摩院算法專家康楊楊、宋凱嵩、孫常龍,印第安納大學博士后Di Tang參與論文相關工作。

隨著基于Transformer的BERT等預訓練模型的提出和廣泛應用,經(jīng)過深度預訓練和微調(diào)的Transformer在眾多文本排序任務中取得了最優(yōu)越的性能。然而,神經(jīng)排序模型繼承了神經(jīng)網(wǎng)絡的對抗性弱點,即一個小的故意的擾動(例如,圖像上的一些像素變化、文本中幾個字符的改變)可能會引發(fā)預測結(jié)果的極大變化,這種弱點可能被用作搜索引擎毒化、觀點引導等。先前的對抗排序攻擊主要集中在基于深度圖像排序系統(tǒng)、文本分類和機器翻譯系統(tǒng)上,而深度文本排序模型的漏洞尚未得到較多探索。此外,真實場景下的排序系統(tǒng)禁止任何形式的白盒訪問,黑盒攻擊更能揭示貼近實際的排序系統(tǒng)漏洞。

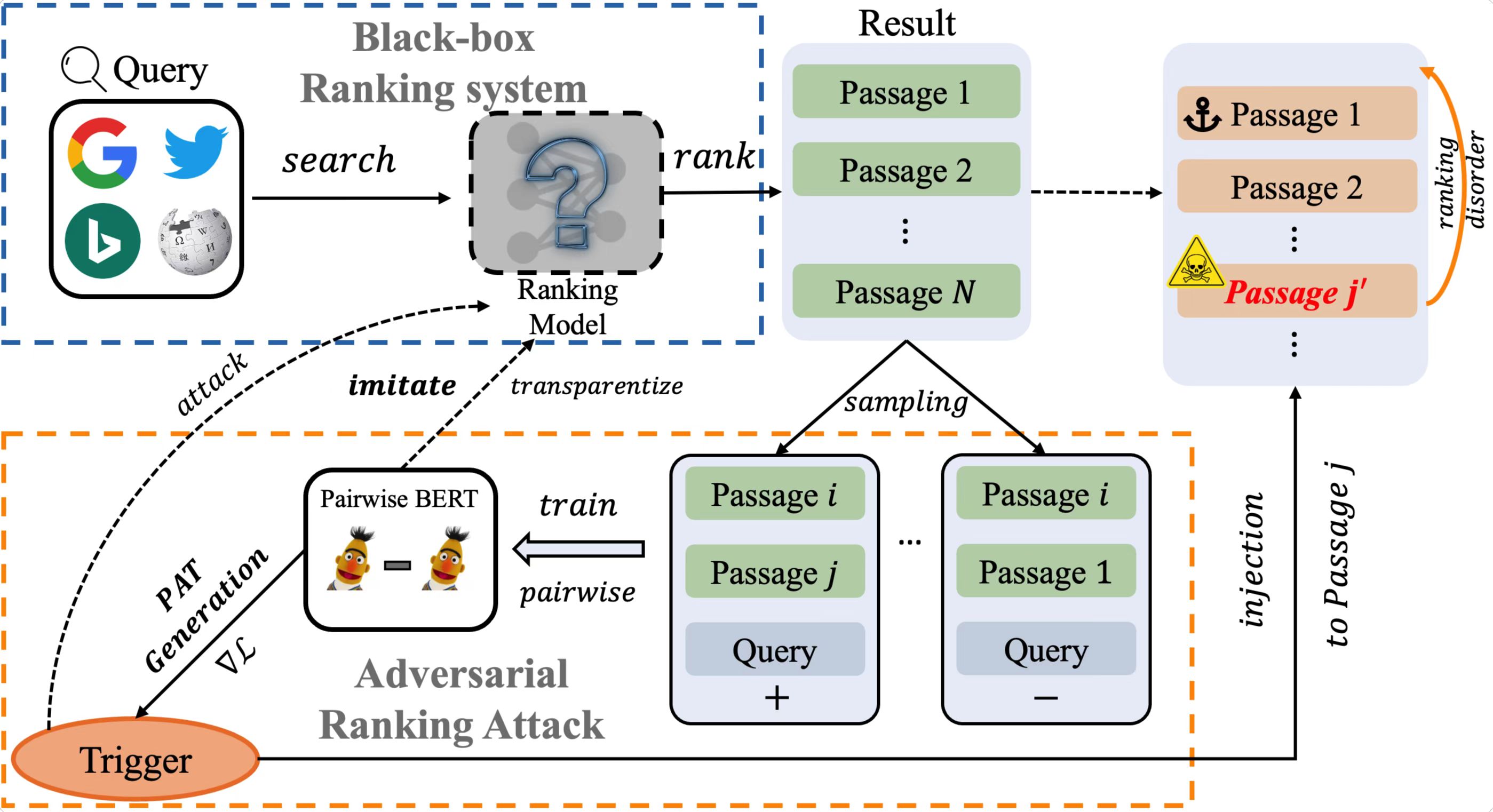

該論文利用不同神經(jīng)網(wǎng)絡之間的對抗樣本的可轉(zhuǎn)移特性,提出了一種針對深度文本排序系統(tǒng)的新型黑盒攻擊方法,揭示了深度文本排序模型存在的安全漏洞。通過采樣目標排序模型的結(jié)果列表,無需任何白盒訪問權(quán)限,訓練一個模仿模型來替代目標排序模型,基于替代模型生成對抗攻擊文本,然后遷移到目標排序模型上驗證攻擊效果。大量的自動檢測和人工評測證明,該方法能夠以黑盒方式有效實現(xiàn)攻擊目標。

ACM CCS已有近30年的歷史,在系統(tǒng)及網(wǎng)絡安全領域享有崇高的聲譽,一直引領國際信息安全研究的潮流,谷歌H-5指數(shù)為98,為計算機安全與密碼學領域期刊會議最高,同時被中國計算機學會(CCF)認定為網(wǎng)絡安全A類國際學術(shù)會議,與IEEE S&P、USENIX Security、NDSS被業(yè)界并稱為網(wǎng)絡安全領域“四大頂級會議”。

2021年,劉家偉曾在人工智能領域頂級會議AAAI(CCF-A類)發(fā)表論文“Time to Transfer: Predicting and Evaluating Machine-Human Chatting Handoff”。這是我院首次在CCS和AAAI發(fā)表論文。(責編雷婷)

論文錄用列表:https://www.sigsac.org/ccs/CCS2022/program/accepted-papers.html

論文預印版鏈接:https://arxiv.org/abs/2209.06506